Intelligence artificielle et deepfake : quelles implications pour la vidéo ?

L'intelligence artificielle a révolutionné de nombreux domaines et, parmi ses applications fascinantes, les deepfakes se distinguent par leur potentiel et les questions éthiques qu'ils soulèvent. Ces vidéos hyper-réalistes, créées par des technologies d'apprentissage profond avancées, imitent à s'y méprendre des images et des vidéos authentiques. La question n'est pas simplement de savoir comment ces outils transforment le paysage numérique actuel, mais bien de comprendre les implications qui en découlent. Les deepfakes pourraient bien redéfinir notre relation aux images et aux vidéos, tout en posant des défis inédits, notamment éthiques.

En explorant ces nouvelles frontières technologiques, il apparaît évident que l'usage des deepfakes ne se cantonne pas au divertissement ou à la désinformation. Des campagnes innovantes, des expériences culturelles inédites et des outils d'accessibilité en sont quelques exemples positifs. Cependant, la puissance de ces technologies engendre aussi de sérieuses préoccupations en matière de manipulation et de sécurité. Ainsi, tout en adoptant les nouvelles opportunités à bras ouverts, une introspection s'impose sur les enjeux sociaux et moraux.

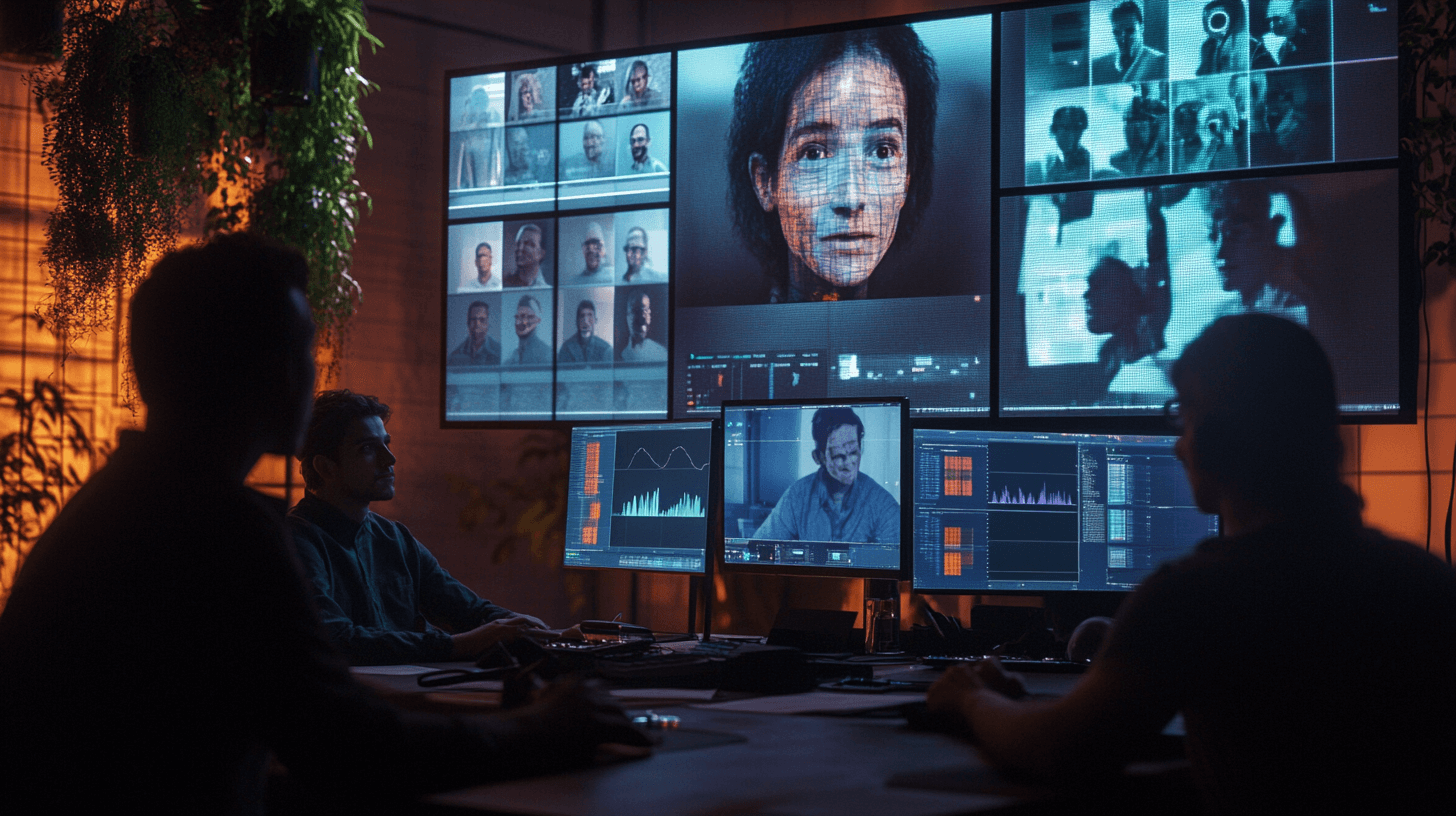

Comprendre la technologie des deepfakes

Les deepfakes résultent d'une combinaison complexe de technologies d'apprentissage profond, où des algorithmes s'affinent au fil des données traitées. Ces techniques, majeures dans l'intelligence artificielle, permettent de fusionner, remplacer et superposer des images ou des séquences vidéo pour produire des contenus faussement authentiques. Le processus s'appuie sur des réseaux antagonistes génératifs (GANs) qui opposent deux réseaux neuronaux : l'un crée des images synthétiques, tandis que l'autre évalue leur authenticité.

Cela soulève des questions sur l'évolution de notre perception de la réalité. En dépit du fossé entre création virtuelle et vérité tangible, la ligne s'estompe à une vitesse inouïe. Le défi majeur réside donc dans la capacité à distinguer le réel du simulacre sans sombrer dans une approche cynique du contenu audio-visuel numérique. Ainsi, discerner les opportunités des risques devient crucial pour naviguer dans ce nouvel univers audiovisuel.

Les applications positives des deepfakes

Malgré leurs controverses, les applications potentielles des deepfakes ne sont pas toutes négatives. Dans le monde du marketing, par exemple, la création de salles d'essayage virtuelles offre la possibilité aux consommateurs d'essayer des vêtements sans se déplacer physiquement, redéfinissant l'expérience d'achat. Par ailleurs, les deepfakes s’insèrent également dans le secteur de la santé et de l’aide aux personnes handicapées, en facilitant des traductions en temps réel ou la création de sous-titres personnalisés, particulièrement bénéfiques pour les malentendants.

Médias et journalisme : un accès simplifié aux informations

L'usage des deepfakes dans les médias, tel que démontré par Reuters, illustre comment ces technologies peuvent servir à personnaliser l'expérience d’information. En générant des reporters virtuels et des bulletins d'information dans plusieurs langues, les contenus deviennent plus accessibles, transcendant des barrières linguistiques souvent limitatrices. Cette innovation permet d'atteindre des audiences plus variées et d'élargir le public cible des médias traditionnels.

Les défis éthiques et sécuritaires des deepfakes

Les enjeux posés par les deepfakes ne se limitent pas aux bénéfices qu'ils peuvent apporter. L'une des préoccupations majeures concerne la manipulation d'informations et son utilisation potentielle dans la désinformation. La création de médias synthétiques peut nuire à la légitimité des discours publics, exacerber les crises politiques, et ouvrir la porte à des actions malveillantes, telles que le chantage ou la diffusion de contenu non consentie.

Confidentialité et consentement : la frontière invisible

Les questions autour du respect de la vie privée et du consentement représentent également une part essentielle des enjeux liés aux deepfakes. À l'ère où la vie numérique prend le pas sur notre quotidien, utiliser l'image ou la voix de quelqu'un sans approbation soulève de sérieux débats éthiques. Il est impératif pour la société de statuer sur les limites de ces pratiques, afin de protéger les individus face à des potentielles dérives.

L'incertitude autour de la sécurité est aussi présente dans les sphères de la défense, où les deepfakes pourraient être utilisés pour tester la robustesse des systèmes de sécurité numériques ou, dans le pire des cas, pour orchestrer des cyberattaques sophistiquées. Anticiper ces menaces nécessite une prise de conscience et une préparation adéquate à l'échelle globale.

Vers un usage responsable et éthique des deepfakes

Pour déjouer les menaces liées aux deepfakes, plusieurs entreprises comme iDenfy travaillent sur des solutions innovantes capables de détecter et prévenir les abus. Ces technologies doivent toutefois être intégrées dans une régulation plus large, garantissant l'équilibre entre innovation et sauvegarde des libertés fondamentales. Selon nous, une législation adaptée et une veille constante des progrès technologiques s'avèrent impératives pour éviter les dérives.

En conclusion, alors que les deepfakes continuent de modifier notre compréhension des médias et notre rapport à la réalité, articuler leur usage autour de principes éthiques et d'une responsabilité collective est essentiel. Ce dialogue entre innovation et éthique doit être maintenu pour naviguer avec succès dans cette nouvelle ère technologique.

En adaptant ces pratiques, nous pourrons peut-être saisir l'ensemble des opportunités offertes par les deepfakes tout en anticipant les challenges qu'ils impliquent.